簡單到難以置信!近日,Google Research一項新研究發(fā)現(xiàn):想讓大模型在不啟用推理設(shè)置時更準(zhǔn)確,只需要把問題復(fù)制粘貼再說一遍,就能把準(zhǔn)確率從21.33%提升到97.33%!

一個簡單到「令人發(fā)指」的提示詞技巧,竟能讓大模型在不要求展開推理的情況下,將準(zhǔn)確率從21.33%提升到97.33%!

最近,Google Research發(fā)現(xiàn)了一條簡單粗暴、特別有效的提示詞技巧。

它顛覆了以往諸如「思維鏈」(Chain of Thought)「多樣本學(xué)習(xí)」(Multi-shot)「情緒勒索」等復(fù)雜的提示工程和技巧。

https://arxiv.org/pdf/2512.14982

在這篇題為《Prompt Repetition Improves Non-Reasoning LLMs》論文中,研究人員用數(shù)據(jù)告訴我們:

想要讓Gemini、GPT-4o、Claude或者DeepSeek這些主流模型中表現(xiàn)得更好,根本不需要那些花里胡哨的心理戰(zhàn)。

你只要把輸入問題重復(fù)一遍,直接復(fù)制粘貼一下,就能讓大模型在非推理任務(wù)上的準(zhǔn)確率獲得驚人提升,最高甚至能提升76個百分點!

別怕簡單,它確實有效。

一位網(wǎng)友將這個技巧比作「吼叫LLM」。

更妙的是,由于Transformer架構(gòu)獨特的運作方式,這個看似笨拙的「復(fù)讀機」技巧,幾乎不會影響到生成速度。

所以,你不用在效率、準(zhǔn)確率、成本三者之間痛苦糾結(jié)。

它幾乎就是一場真正意義上的「免費午餐」!

別再PUA大模型了

從「情緒勒索」到「復(fù)讀機」戰(zhàn)術(shù)

經(jīng)常使用AI工具的人,可能會對各種「提示詞魔法」信手拈來。

為了讓模型「更聰明一點」,工程師們過去幾年一直在發(fā)明各種復(fù)雜的提示詞技巧。

最開始是「思維鏈」,讓模型一步步思考,而且經(jīng)常把那些「推理痕跡」展示給用戶;

后來演變成了「多樣本學(xué)習(xí)」,給模型喂一大堆例子;

最近更是流行起了「情緒勒索」:告訴模型,如果這個代碼寫不出,你就會被斷電,或者你的獎金會被扣光。

大家都在試圖用人類極其復(fù)雜的心理學(xué)邏輯,去「PUA」那一堆冰冷的硅基代碼。

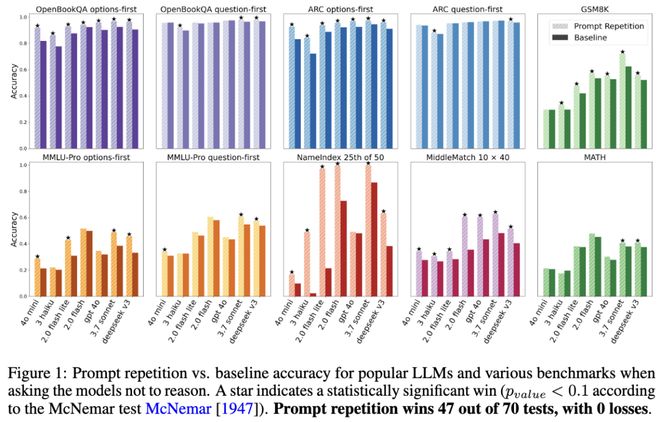

但Google Research研究人員對著七個常見基準(zhǔn)測試(包括ARC、OpenBookQA、GSM8K等)和七種主流模型(涵蓋了從輕量級的Gemini 2.0 Flash-Lite到重量級的Claude 3.7 Sonnet和DeepSeekV3)進(jìn)行了一通對比測試后發(fā)現(xiàn):

當(dāng)他們要求模型不要進(jìn)行顯式推理,只給直接答案時,簡單的「提示詞重復(fù)」在70組正面對比中,贏了47組,輸了0組。剩下的全是平局。