Thinking Machines Lab 發布首款產品 Tinker,大幅降低大模型微調門檻

北京,2025年10月2日 —— 由前 OpenAI 高管 Mira Murati、翁荔(Lilian Weng)與陳丹琦聯合創立的 Thinking Machines Lab,今日正式發布其首款產品——Tinker,一款面向研究人員的語言模型微調 API 工具,旨在讓模型微調“像改 Python 代碼一樣簡單”。

打破壁壘:微調不再高不可攀

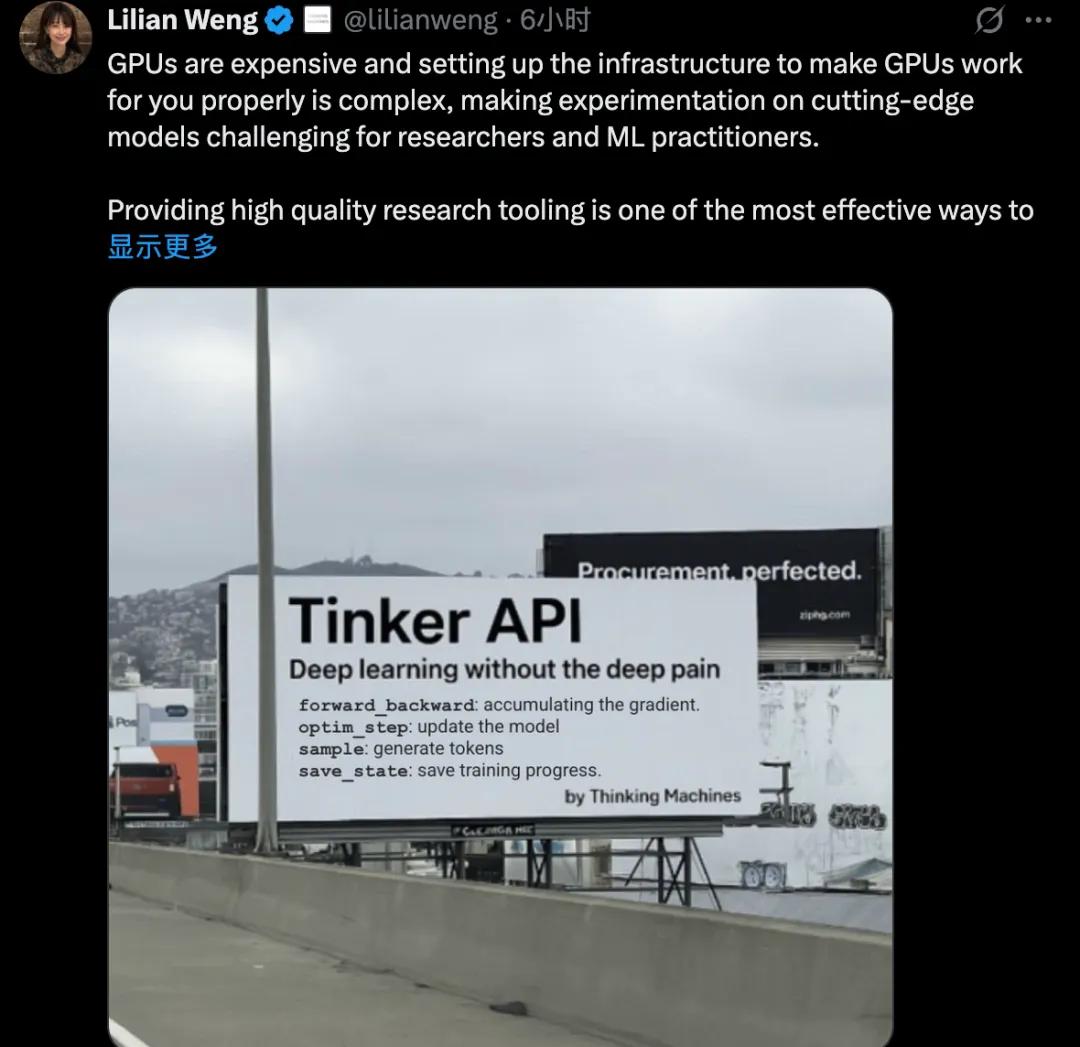

Tinker 的推出標志著 Thinking Machines Lab 正式摘掉“0 產品 0 收入估值 840 億”的標簽。聯合創始人翁荔表示:“GPU 價格昂貴,基礎設施搭建復雜,這讓很多研究人員難以接觸前沿模型。Tinker 是我們提升研究生產力的第一步。”

與傳統“上傳數據、我們幫你訓練”的黑箱模式不同,Tinker 讓研究人員保留對數據、損失函數與算法的完全控制權,同時自動處理分布式訓練、前后向傳播、錯誤恢復等底層細節。用戶只需修改一行代碼,即可從小模型切換至大模型,支持 Qwen3 與 Llama3 系列。

開源+靈活:研究社區的“新玩具”

Tinker 提供底層訓練接口如 forward_backward 與 sample,并采用 LoRA 技術實現多任務共享 GPU,顯著降低實驗成本。除云托管服務外,團隊還開源了 Tinker Cookbook,涵蓋多種后訓練方法實現,供社區自由使用。

微軟研究員在代碼審查中發現,Tinker 并未采用 DeepSeek 提出的 GRPO 方法,而是使用經典 REINFORCE 算法配合優勢函數,簡化了梯度更新流程。其更新策略可概括為:

新參數 = 原參數 + 學習率 × 優勢值 × 對數概率的梯度

業內反響:抽象與可控的平衡點

AI 基礎設施公司 Anyscale 的 CEO Robert Nishihara 表示,Tinker 在“抽象化與可調性之間取得了卓越平衡”。普林斯頓、斯坦福、伯克利與 Redwood Research 等頂尖研究團隊已成為首批用戶,并基于 Tinker 完成多項實驗。

AI 研究者 Andrej Karpathy 公開評價稱:“Tinker 很酷。它讓微調不再是‘換風格’,而是縮小任務范圍的有效手段。尤其在訓練樣本充足時,微調小模型往往優于構建復雜 prompt。”

“重新發明一個 OpenAI”

Tinker 的發布只是開始。據多家媒體報道,Thinking Machines Lab 正在嘗試“重新發明一個 OpenAI”——重建那個“尚未官僚化、公開分享成果、給研究者自由”的 OpenAI。

與此同時,OpenAI 則似乎正走向另一條路。近日,其 ChatGPT 應用代碼中被發現正在測試“社交模式”,包括群聊通知、頭像與昵稱設置等功能,暗示其或將打造“AI 抖音”式社交平臺。

關于 Thinking Machines Lab

Thinking Machines Lab 成立于 2024 年,由 Mira Murati、Lilian Weng 與陳丹琦聯合創立,致力于降低 AI 研究門檻,推動前沿模型民主化。公司目前估值 84 億美元,總部位于舊金山。