多模態(tài)大模型(MLLMs)雖然在圖像理解、視頻分析上表現(xiàn)出色,但多停留在整體場景級理解。

而場景級理解 ≠ 視覺理解的終點,現(xiàn)實任務(wù)(如自動駕駛、機器人、醫(yī)療影像、視頻分析)需要的是細(xì)粒度、對象級(object-level)詳細(xì)理解。

然而,當(dāng)下的研究工作,如英偉達(dá)的Describe Anything Model (DAM)局限于單個物體的描述,難以深入理解多對象屬性、交互關(guān)系及其時序演變,且犧牲了模型本身的通用理解能力。

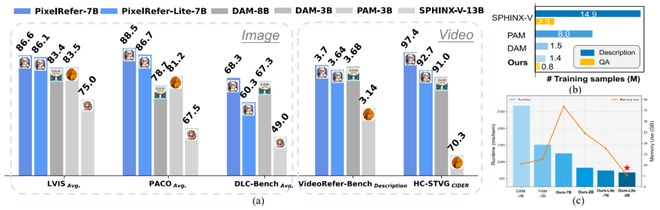

針對這一問題,浙江大學(xué)、達(dá)摩院、香港理工大學(xué)聯(lián)合提出了一種創(chuàng)新的解決方案PixelRefer:一個統(tǒng)一的時空像素級區(qū)域級理解框架,可實現(xiàn)任意粒度下的精細(xì)視覺指代與推理,在多項像素級細(xì)粒度理解任務(wù)取得領(lǐng)先性能表現(xiàn)。和DAM-3B相比,輕量版的2B模型推理時間加快了4倍,顯存占用減半,且訓(xùn)練數(shù)據(jù)量大大少于已有方法。

PixelRefer能夠?qū)θ我饽繕?biāo)實現(xiàn)準(zhǔn)確語義理解以及時空物體區(qū)域理解。